Die Diskussion über die Frage, ab wann Künstliche Intelligenz (KI) als gefährlich eingestuft werden kann, gewinnt zunehmend an Bedeutung, insbesondere in Anbetracht der rasant fortschreitenden Technologie. Regulierungsbehörden weltweit haben begonnen, spezifische Risikostufen für verschiedene KI-Systeme zu definieren, um die Sicherheit der Nutzer zu gewährleisten. In dieser Analyse betrachten wir die neuesten Berechnungen und Maßnahmen, die darauf abzielen, die potenziellen Gefahren, die von fortschrittlichen KI-Anwendungen ausgehen können, angemessen einzuschätzen und zu regulieren. Die Herausforderungen und Risiken, die sich aus einem unkontrollierten Einsatz von KI ergeben, sind nicht nur technischer Natur, sondern betreffen auch soziale und ethische Fragen, die im Zentrum der aktuellen Debatte stehen.

Inhaltsübersicht

ToggleEinleitung: Künstliche Intelligenz im Fokus

Künstliche Intelligenz (KI) ist ein faszinierendes, aber auch kontroverses Thema, das in den letzten Jahren zunehmend in den Mittelpunkt der gesellschaftlichen und wissenschaftlichen Diskussion gerückt ist. Mit den rasanten Fortschritten in der Technologie hat auch das Bedürfnis nach einer effektiven Regulierung zugenommen. In diesem Artikel werden wir uns mit der Frage befassen, ab wann KI als gefährlich betrachtet wird und wie die Regulierungsbehörden ihre Berechnungen anstellen, um potenzielle Risiken zu bewerten.

Die Risiken von Künstlicher Intelligenz

Die Debatte über die Gefahren von KI dreht sich hauptsächlich um zwei Aspekte: die Sicherheit der Nutzer und die möglichen negativen Auswirkungen auf die Gesellschaft. Ein zentraler Punkt ist die Autonomie von fortgeschrittenen KI-Systemen, die in der Lage sein könnten, unabhängig von menschlichen Eingriffen zu agieren. Die schleichende Verselbstständigung solcher Systeme könnte zu einer Gefährdung werden, wie es bereits in verschiedenen Studien und Analysen gewarnt wurde.

Regulatory Frameworks und der AI Act

Die Einführung des AI Act in der Europäischen Union markiert einen wichtigen Schritt in der Regulierung von KI-Technologien. Dieser rechtliche Rahmen gliedert die KI-Systeme nach Risiko-Stufen, wobei besonders gefährliche Anwendungen strengen Vorschriften unterliegen. Die Regulierungsbehörden setzen dabei auf ein differenziertes Vorgehen, das sowohl technische als auch ethische Gesichtspunkte in Betracht zieht.

Berechnungen der Regulierungsbehörden

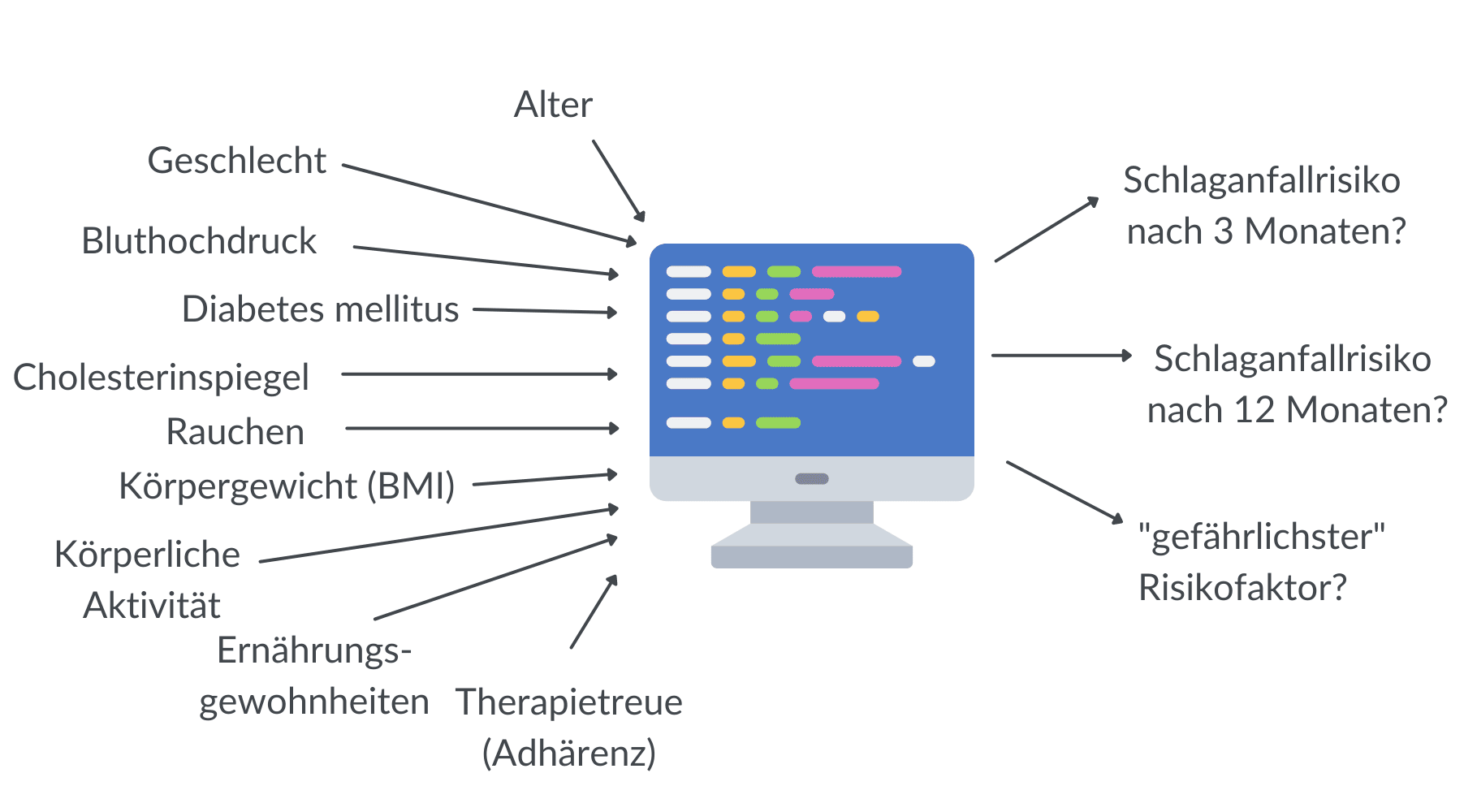

Die Regulierungsbehörden verwenden eine Vielzahl von Methoden, um die möglichen Risiken von KI-Systemen zu bewerten. Eine gängige Methode ist die Durchführung von Risikobewertungen, die sowohl die Wahrscheinlichkeit des Auftretens von Risiken als auch die Schwere der möglichen Auswirkungen analysieren. Diese Berechnungen helfen, potenzielle Gefahren frühzeitig zu erkennen und geeignete Maßnahmen zum Schutz der Verbraucher zu ergreifen.

Hochrisiko-KI-Systeme

Im Rahmen der Risikoanalysen wird auch zwischen unterschiedlichen Typen von KI-Systemen unterschieden. Hochrisiko-KI-Systeme sind solche, bei denen ein hohes Schadenspotenzial besteht, sei es durch Fehlentscheidungen, Sicherheitslücken oder unethische Anwendungen. Die Regulierungsbehörden legen besonderen Wert auf die Überwachung und Kontrolle dieser Systeme, um potenzielle Gefahren zu minimieren.

Die Herausforderung der Regulierung

Eine der größten Herausforderungen bei der Regulierung von KI besteht darin, mit den schnellen technologischen Entwicklungen Schritt zu halten. Besonders in einem dynamischen Umfeld, in dem neue Anwendungen und Algorithmen ständig entwickelt werden, müssen Regulierungsbehörden flexibel bleiben und aufkommende Risiken zeitnah adressieren.

Fazit: Die Zukunft der KI-Regulierung

Die Betrachtung der Gefahren von Künstlicher Intelligenz erfordert eine umfassende Analyse und sorgfältige Überlegungen seitens der Regulierungsbehörden. Während die fortschreitende Integration von KI in verschiedenen Bereichen der Gesellschaft jede Menge Chancen bietet, ist gleichzeitig eine verantwortungsvolle Verwaltung unerlässlich, um die Sicherheitsinteressen der Nutzer zu gewährleisten. Der AI Act stellt einen wichtigen ersten Schritt dar, doch die kontinuierliche Adaptation der Regulierungsansätze wird entscheidend sein, um zukünftige Herausforderungen zu meistern.

Das neue Wissenschafts-Netzwerk für KI-Risiken „Kira“ drängt auf eine schnelle Regulierung von Künstlicher Intelligenz. Sprecher Privitera sagte im Dlf, es gebe immer bessere und stärkere KI-Modelle, die teils selbstständig strategisch handelten und Menschen täuschen könnten.

— Deutschlandfunk (@DLF) June 6, 2023